Facebook usará inteligência artificial para prevenção de suicídio no Brasil

O Facebook anunciou nesta segunda-feira (27) que está expandindo e melhorando suas ferramentas voltadas para a prevenção do suicídio e da automutilação. De acordo com a empresa, as novidades envolvem o uso da inteligência artificial para melhor detectar sinais de pensamentos suicidas em publicações e transmissões ao vivo em vários países do mundo, incluindo o Brasil.

Até então, essa tecnologia só funcionava nos Estados Unidos. Além da inteligência artificial, a rede social informou que está ampliando a quantidade de profissionais responsáveis por analisar denúncias de conteúdos relacionados ao suicídio. Essa equipe ainda ajudará a responder esses alertas mais rapidamente.

VEJA TAMBÉM:

- 'Checava se alguém se mataria ao vivo', conta moderador brasileiro no Facebook

- Primeiro presidente do Facebook diz que rede explora vulnerabilidade humana

O número de pessoas que compõe a equipe de revisores não foi informado, mas o Facebook destacou que são milhares de especialistas treinados em suicídio e automutilação e eles trabalham 24h por dia ao redor do mundo.

Em uma publicação feita em maio deste ano, o fundador Mark Zuckerberg afirmou que cerca de 4.500 pessoas trabalhavam nos times que analisam as denúncias feitas na rede social. A previsão feita na época era que em 2018 mais 3 mil pessoas seriam contratadas para atuar nessa área.

"Durante o último mês, trabalhamos com serviços de emergência em mais de 100 ocasiões em que a tecnologia nos ajudou a identificar sinais de comportamento suicida ou de automutilação. Também usamos a tecnologia para acelerar o tempo de resposta às denúncias mais sérias que possam envolver risco à vida de pessoas, casos que merecem uma ação prioritária", afirmou Guy Rosen, vice-presidente de gerenciamento de produto, em nota.

De acordo com Rosen, com a melhoria das ferramentas de prevenção, as autoridades locais podem ser notificadas até duas vezes mais rápido do que em denúncias anteriores.

E como funciona?

O Facebook possui profissionais que analisam as denúncias de conteúdo feitas por usuários dentro da rede social. O trabalho da empresa envolvendo a prevenção ao suicídio existe há cerca de dez anos, mas a empresa diz que seu compromisso é ter sempre uma melhora contínua de seus serviços.

Por isso, além dos revisores, a empresa está investindo no desenvolvimento de sua inteligência artificial para organizar e priorizar publicações, vídeos e/ou transmissões ao vivo que envolvam esses problemas. Entre as novas mudanças está a expansão para outros países do uso dessa tecnologia para ajudar a identificar tendências suicidas fora dos Estados Unidos.

"Essa abordagem usa tecnologia de reconhecimento de padrões para ajudar a identificar publicações e transmissões ao vivo como possíveis de expressar pensamentos suicidas. Continuamos a trabalhar nessa tecnologia para aumentar sua precisão e evitar falsos positivos", explicou Rosen.

"Usamos sinais como o texto usado em posts e comentários (por exemplo, comentários como "você está bem?" ou "posso ajudar?" podem ser sinais de que uma pessoa está enfrentando dificuldade emocional). Em algumas ocasiões, a tecnologia identificou vídeos que poderiam não ter sido reportados por nossa comunidade", acrescentou.

Uma vez detectado riscos aos usuários, os revisores conseguem alertar autoridades e serviços de emergência. "Nossos revisores podem, por exemplo, identificar rapidamente quais trechos dentro de um vídeo motivaram um aumento nos comentários, reações e denúncias das pessoas. Isso ajuda nossos revisores a entender rapidamente se alguém pode estar em perigo e assim, podemos acionar ajuda", destacou o executivo.

O que fazer caso eu veja uma publicação suspeita?

Caso o usuário observe o comportamento suspeito de alguém com ideias suicidas ou mensagens pessimistas, ele pode entrar em contato diretamente com ela ou denunciar a publicação.

Segundo a empresa, uma série de informações e materiais de apoio passa a aparecer na timeline do usuário, como opção de contatar um amigo e/ou informações sobre o serviço do CVV (Centro de Valorização da Vida), no caso do Brasil.

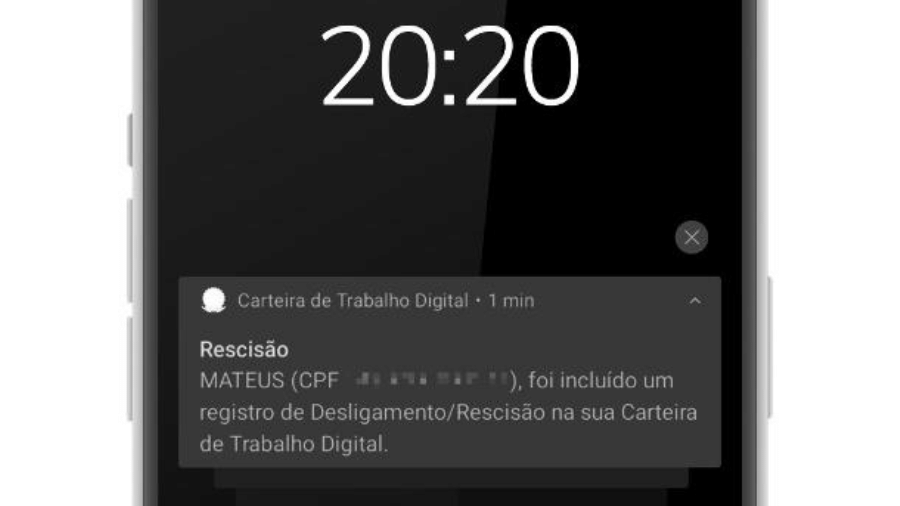

Para denunciar uma publicação ou vídeo, é preciso clicar na seta do lado direito superior do post e escolher "denunciar publicação". Em seguida, deverá detalhar qual é o problema do post escolhendo a opção "acredito que não deveria estar no Facebook" e, depois, "é ameaçador, violento ou suicida".

Esse serviço começou a funcionar no Brasil em junho de 2016 e é interessante saber que quem denuncia a publicação também recebe uma mensagem com dicas de como ajudar alguém que está enfrentando dificuldades.

Caso o conteúdo suspeito seja de um vídeo transmitido ao vivo pelo Facebook, também é possível fazer a denúncia. Durante a transmissão, basta clicar na seguinte sequência: "denuncie vídeo ao vivo" > "suicídio ou automutilação" > "Enviar".

ID: {{comments.info.id}}

URL: {{comments.info.url}}

Ocorreu um erro ao carregar os comentários.

Por favor, tente novamente mais tarde.

{{comments.total}} Comentário

{{comments.total}} Comentários

Seja o primeiro a comentar

Essa discussão está encerrada

Não é possivel enviar novos comentários.

Essa área é exclusiva para você, assinante, ler e comentar.

Só assinantes do UOL podem comentar

Ainda não é assinante? Assine já.

Se você já é assinante do UOL, faça seu login.

O autor da mensagem, e não o UOL, é o responsável pelo comentário. Reserve um tempo para ler as Regras de Uso para comentários.